AIによる生物兵器開発防止のため、危険な生物学データへのアクセス制限を提案

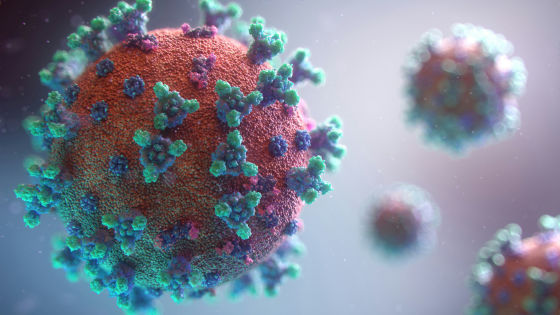

オックスフォード大学やスタンフォード大学などの科学者100人以上が、AIによる生物兵器開発を防ぐため、生物学データへの段階的なアクセス制限を提案しました。この枠組み「バイオセキュリティデータレベル(BDL)」は、危険度の高いデータほどアクセス制限を強化するもので、5つのレベルに分類されます。

BDL-0:規制なし

BDL-1:真核生物感染パターン学習用

BDL-2:パンデミックを引き起こす可能性のあるデータ

BDL-3:ヒト感染性ウイルスに関する詳細な遺伝子配列

BDL-4:AIによる危険なウイルス変異体設計が可能となるデータ

アクセスには、政府発行ID、機関所属確認、不正行為者スクリーニング、正当利用確認、リスク評価などが求められます。BDL-4では、政府によるAIモデルの事前審査も必要となります。

この枠組みは、危険な病原体を扱う実験室の安全対策に倣い、データにも段階的なセキュリティレベルを設けることを目指しています。既存のデータセットには影響を与えず、新たに収集されたデータのみが対象となります。

反対意見としては、アクセス制限がAI能力を損なわないという主張がありますが、研究者らは、ウイルス特異的なタンパク質や遺伝子配列を除外したAIモデルはパフォーマンス低下を示す実験結果があることを指摘しています。

バイオセキュリティデータレベルの導入は困難だと考えられますが、すでにNIHやオックスフォード大学では、データアクセスを厳格に管理するシステムが運用されています。

背景

近年、AI技術の進歩は様々な分野で期待されていますが、その一方で生物兵器開発など悪用される可能性も懸念されています。このニュースは、AIによる生物兵器開発を防ぐために、科学者らが提案した新たな枠組み「バイオセキュリティデータレベル」について報じています。

重要用語解説

・バイオセキュリティデータレベル(BDL):危険度の高い生物学データを段階的に分類し、アクセス制限を設ける枠組み。

・BSL-4:最も高度な安全対策が必要とされる実験室の封じ込めレベル。

・パンデミック:広範囲にわたって発生する感染症流行のこと。

今後の影響

このニュースは、AI技術の倫理的な利用に関する議論をさらに活発化させる可能性があります。また、政府や研究機関が生物学データの管理方法を見直す必要性も浮き彫りになりました。