AIがバイナリコードのバックドア検出に挑戦!成功率は?

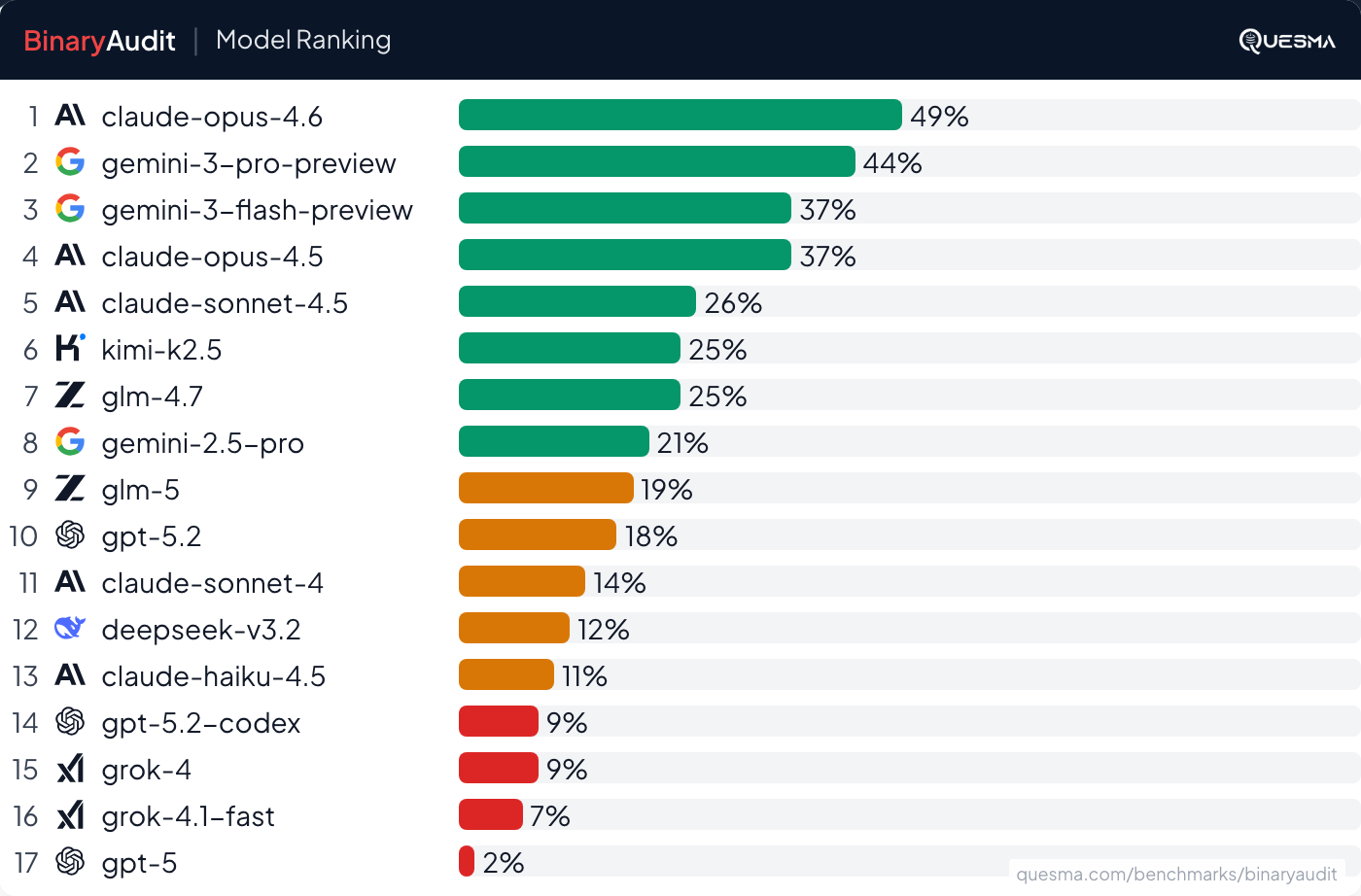

研究チームは、AIモデルにバイナリコード中のバックドアを検出するタスクを与え、その能力を試しました。彼らはオープンソースソフトウェアに人工的にバックドアを埋め込み、AIモデルにそれを発見させる実験を行いました。結果として、一部のAIモデルは比較的単純なバックドアを見つけることができたものの、高精度な検出には至っていませんでした。特に、Ghidraなどの逆エンジニアリングツールと連携して分析する必要がある複雑なケースでは、AIモデルは課題に直面しました。研究チームは、この実験を通して、AIがセキュリティ分野で重要な役割を果たす可能性を示唆しつつも、さらなる研究開発が必要であることを強調しています。

背景

近年、サイバー攻撃の増加に伴い、ソフトウェアのセキュリティ対策が重要視されています。特に、バイナリコードはソースコードがないため、バックドアなどの悪意のあるコードを検出するのが困難です。この研究では、AIモデルを用いてバイナリコード中のバックドアを検出する可能性を探ることを目的としています。

重要用語解説

Ghidra: NSAが開発したオープンソースの逆エンジニアリングツール。バイナリコードを解析し、人間の理解しやすい形式に変換します。

Radare2: オープンソースの逆エンジニアリングツール。Ghidraと同様に、バイナリコードを分析し、デコンパイルする機能を提供します。

バックドア: ソフトウェアに隠された悪意のあるコードで、攻撃者がシステムに侵入したり、データ窃取を行うための入り口となります。

AIモデル: 機械学習を用いて訓練されたコンピュータープログラム。パターン認識や予測など、複雑なタスクを実行することができます。

今後の影響

この研究は、AIがセキュリティ分野で重要な役割を果たす可能性を示唆しています。将来的には、AIを活用した自動化されたセキュリティ対策システムが開発され、サイバー攻撃から組織を守るための有効な手段となることが期待されます。