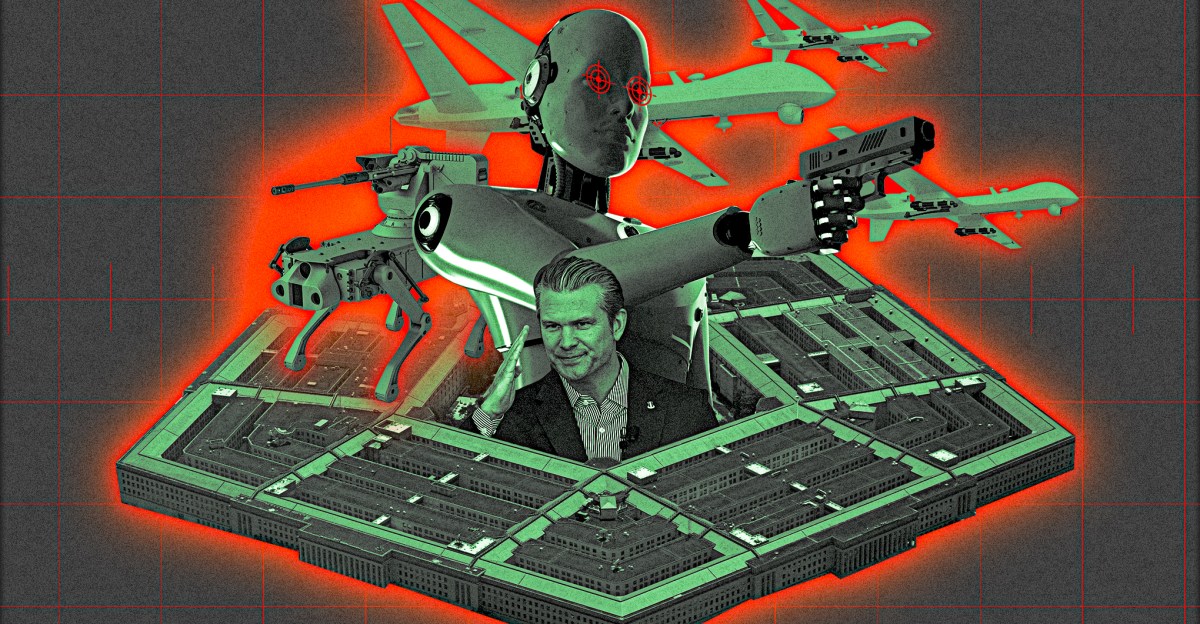

国防総省、AI企業Anthropicと対立

米国のAI企業Anthropicは、国防総省との契約をめぐり、倫理的な使用制限を巡り激しい対立に陥っています。Anthropicは、自律型兵器や大規模な国内監視システムの開発には協力しないと表明しており、国防総省はこれを「woke」だと非難し、Anthropicを「サプライチェーンリスク」として指定する可能性を示唆しています。この措置は、Anthropicが政府機関との契約を失うだけでなく、他の防衛企業もAnthropicのAI技術を使用できなくなるという深刻な影響をもたらす可能性があります。国防総省は、AI開発におけるスピードと安全性のバランスを重視し、「責任あるAI」の概念に疑問を呈しています。一方、Anthropicは、AIの倫理的な使用と民主主義価値の保護を主張しており、政府の要求には反発しています。この対立は、AI技術の軍事利用をめぐる倫理的課題と、政府と民間企業間の権力関係に関する重要な問題を浮き彫りにしています。

背景

Anthropicは、国防総省との2億ドルの契約をめぐり、倫理的な使用制限を巡り対立している。国防総省はAI技術を軍事利用する際にスピードと効率性を重視しており、Anthropicの「責任あるAI」という理念に反発している。この対立は、AI開発における倫理的課題と政府と民間企業間の権力関係に関する重要な問題を浮き彫りにしている。

重要用語解説

• **Anthropic**: 米国のAI企業で、Claudeなどの強力なAIモデルを開発している。

• **国防総省**: アメリカ合衆国の軍事組織。

• **Claude**: Anthropicが開発したAIモデル。高度な自然言語処理能力を持ち、政府機関で使用されている。

• **サプライチェーンリスク**: 企業の供給網に潜む潜在的な脅威。

• **woke**: 社会正義や多様性に関する意識が高いとされる考え方。

今後の影響

Anthropicが国防総省との契約を破棄されれば、AI技術開発における重要なプレイヤーを失うことになる。また、他の防衛企業もAnthropicのAI技術を使用できなくなるため、軍事分野に大きな影響を与える可能性がある。