第8世代TPUを発表:エージェント時代に対応する「学習用」と「推論用」の2チップ戦略

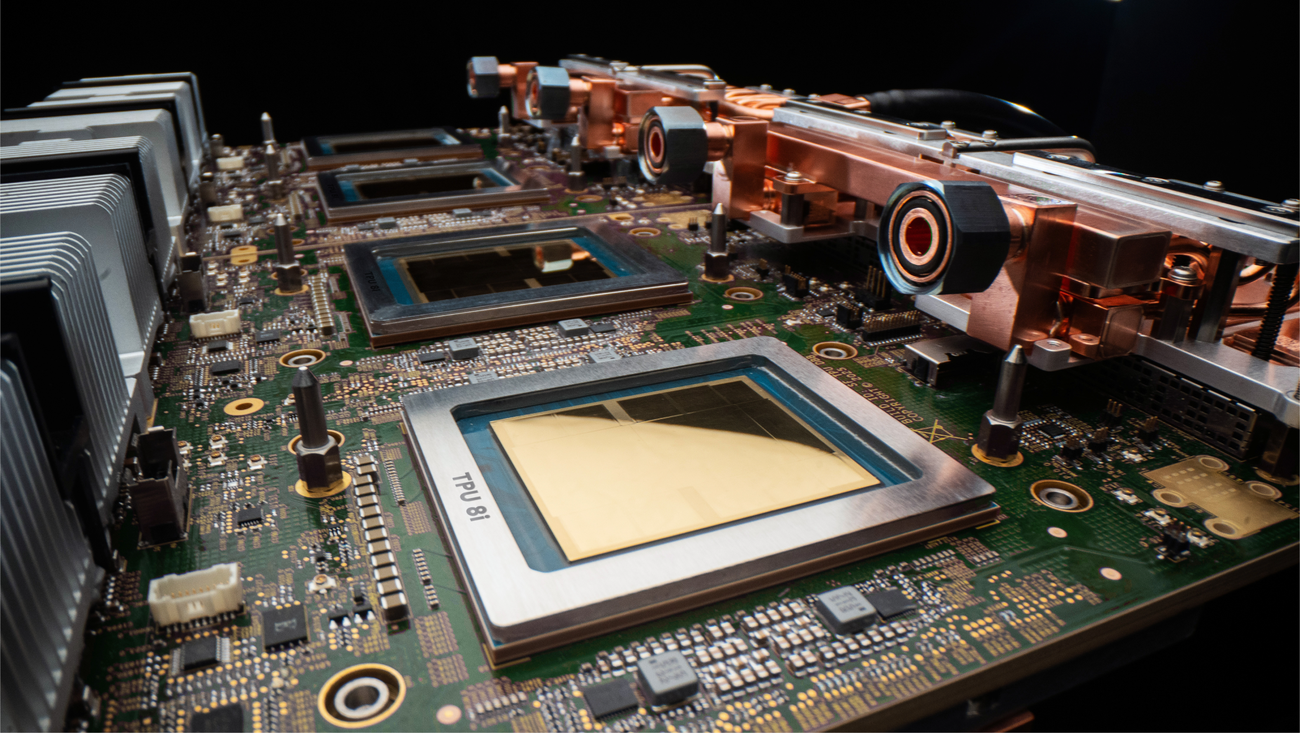

GoogleはGoogle Cloud Nextにおいて、独自のTensor Processor Unit (TPU) の第8世代を発表しました。これは、AIエージェントが複雑な問題解決や多段階のワークフロー実行を行う「エージェント時代」の需要に対応するため、用途別に特化した2つのアーキテクチャ、TPU 8t(トレーニング用)とTPU 8i(推論用)を投入するものです。

**【Who/What】**:Googleが、AIの進化に対応した次世代のカスタムAIチップ「TPU 8t」と「TPU 8i」を発表しました。これらは、大規模なモデルのトレーニング(学習)と、エージェントによる推論(実行)という、AIの二大用途に特化しています。

**【Why/How】**:AIエージェントの台頭により、モデルは単なる応答だけでなく、問題を推論し、複数のステップを実行し、自己の行動から学習する能力が求められています。この高度なワークロードに対応するため、Google DeepMindと共同開発されたTPU 8tとTPU 8iが設計されました。これらは、これまでのTPUの進化の集大成であり、カスタムシリコン、ハードウェア、ネットワーク、ソフトウェアを統合した「共設計(co-design)」の哲学に基づいています。

**【詳細な機能と優位性】**:

1. **TPU 8t(トレーニング用)**:最先端のモデル開発サイクルを「数ヶ月から数週間」に短縮することを目指します。前世代比でポッドあたりの計算性能が約3倍に向上し、単一のスーパーポッドが9,600チップ、2ペタバイトの共有高帯域メモリを扱えます。また、新しいVirgo NetworkとJAX/Pathwaysソフトウェアにより、最大100万チップの論理クラスターでほぼ線形なスケーリングを実現します。

2. **TPU 8i(推論用)**:エージェントの複雑な協調作業(スウォーミング)に対応します。メモリの「壁」を打破するため、288GBの広帯域メモリと384MBのオンチップSRAMを搭載し、モデルの作業セットをチップ上に保持します。また、カスタムAxion ArmベースのCPUと、MoEモデル向けに2倍化されたインターコネクト(ICI)帯域幅(19.2 Tb/s)により、低遅延かつ高効率な推論を実現し、コスト効率を大幅に改善します。

両チップは、前世代比で最大2倍の性能/ワット(Performance-per-watt)を達成し、さらにGoogle独自のAxion ARMベースCPUホスト上で動作することで、システム全体の最適化を図っています。これらのチップは今年後半に一般提供され、GoogleのAIハイパーコンピューターの一部として利用可能となる予定です。

背景

AIの進化に伴い、大規模言語モデル(LLM)のトレーニングと、実環境での推論(エージェントの実行)の需要が爆発的に増加しています。従来の汎用チップでは、この二極化するワークロードの要求に応えきれなくなり、Googleは用途特化型のカスタムAIチップ開発を進めてきました。本発表は、その最新の成果です。

重要用語解説

- Tensor Processor Unit (TPU): Googleが開発した、機械学習(ML)ワークロードに特化したカスタムAIアクセラレータチップ。GPUの代替として、特定の計算タスクで高い効率を発揮します。

- エージェント時代 (Agentic Era): AIが単なる質問応答に留まらず、自律的に目標を設定し、計画を立て、複数のステップを踏んで実行し、結果から学習する、高度なAIシステムが主流となる時代を指します。

- 共設計 (Co-design): ハードウェア(チップ)、ネットワーク、ソフトウェア(フレームワーク)の各要素を、特定のアプリケーションやワークロードの要求に合わせて最初から一体的に設計し、最高の効率を引き出す開発手法です。

今後の影響

TPU 8tと8iの投入は、AIインフラストラクチャの標準を再定義します。これにより、企業はより高速かつ低コストで最先端のAIモデルを開発・運用できるようになり、AIエージェントによる産業革命的な自動化と業務変革が加速すると予想されます。競合他社との技術競争が激化するでしょう。